概要

以前Power Automate Desktop「メロンとメロンパンの違いを完全に理解した話」という記事でPower Automate for desktopとLobeを連携させました。今回はそのモデルをAI Builderにカスタムモデルとして公開しPower AutomateとPower Appsからそれぞれ使用してみます。

注意事項など

- 今回はモデルの作成方法については書いていません。前回の記事を参考にしていただければ幸いです。

- Use AI in Power Apps with Power Fx とImage classification with Lobe はプレビュー機能です。

- Microsoft 365 開発者プログラム、Microsoft Power Apps for DeveloperとAI Builder およびPower Automate無料試用版での検証です。

- Lobe Version 0.10.1130.5

- Windows 10 Pro 21H2

- 自己責任でお願いいたします。

- 2022年4月の投稿です。

LobeモデルをAI Builderのモデルとして公開する

AI Builder >詳細を確認>コンテンツに基づいて画像を分類します(Lobeを利用) を選びます。

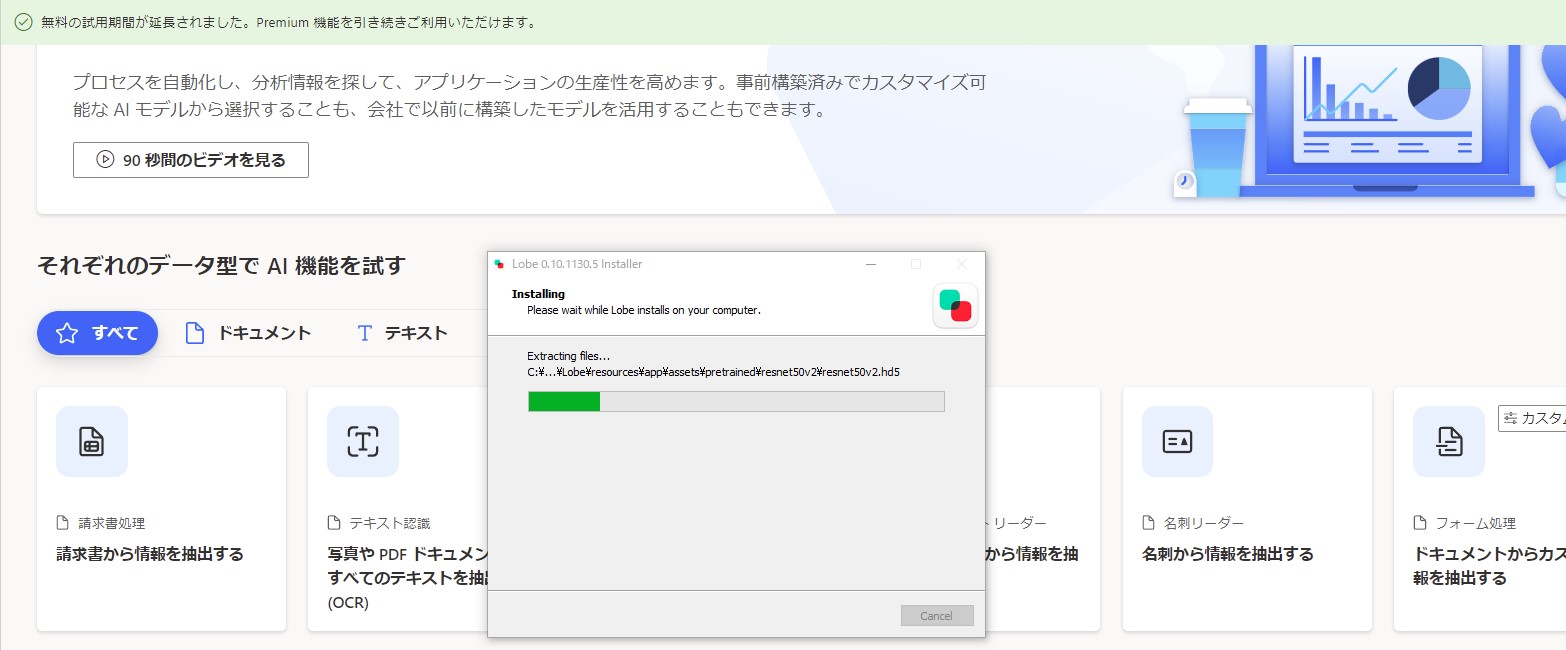

インストールしてない場合はダウンロードします。最新版でない場合もダウンロードしてアップデートします。Lobeについての説明などもあります。

インストールします。

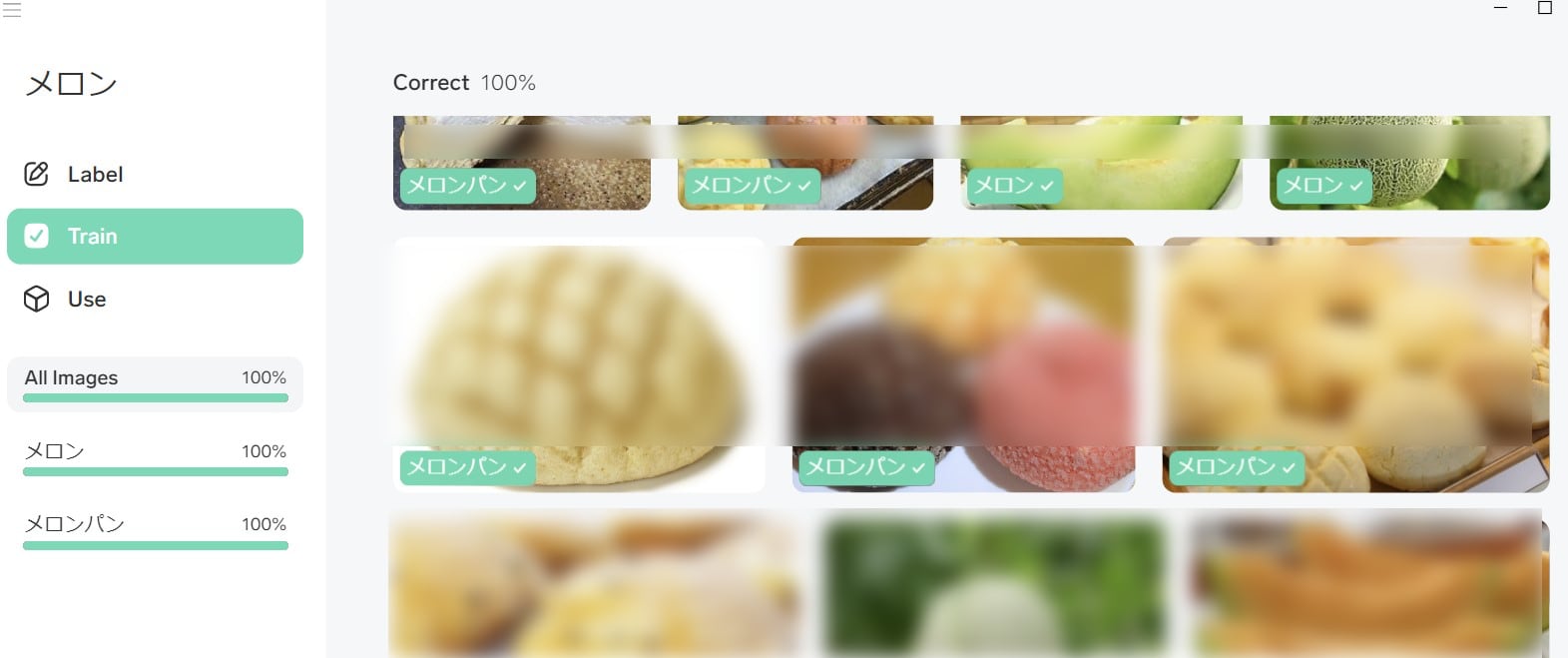

ここでは既存モデルがある前提で進めます。モデルがない場合は前回の記事を参考にしてください。

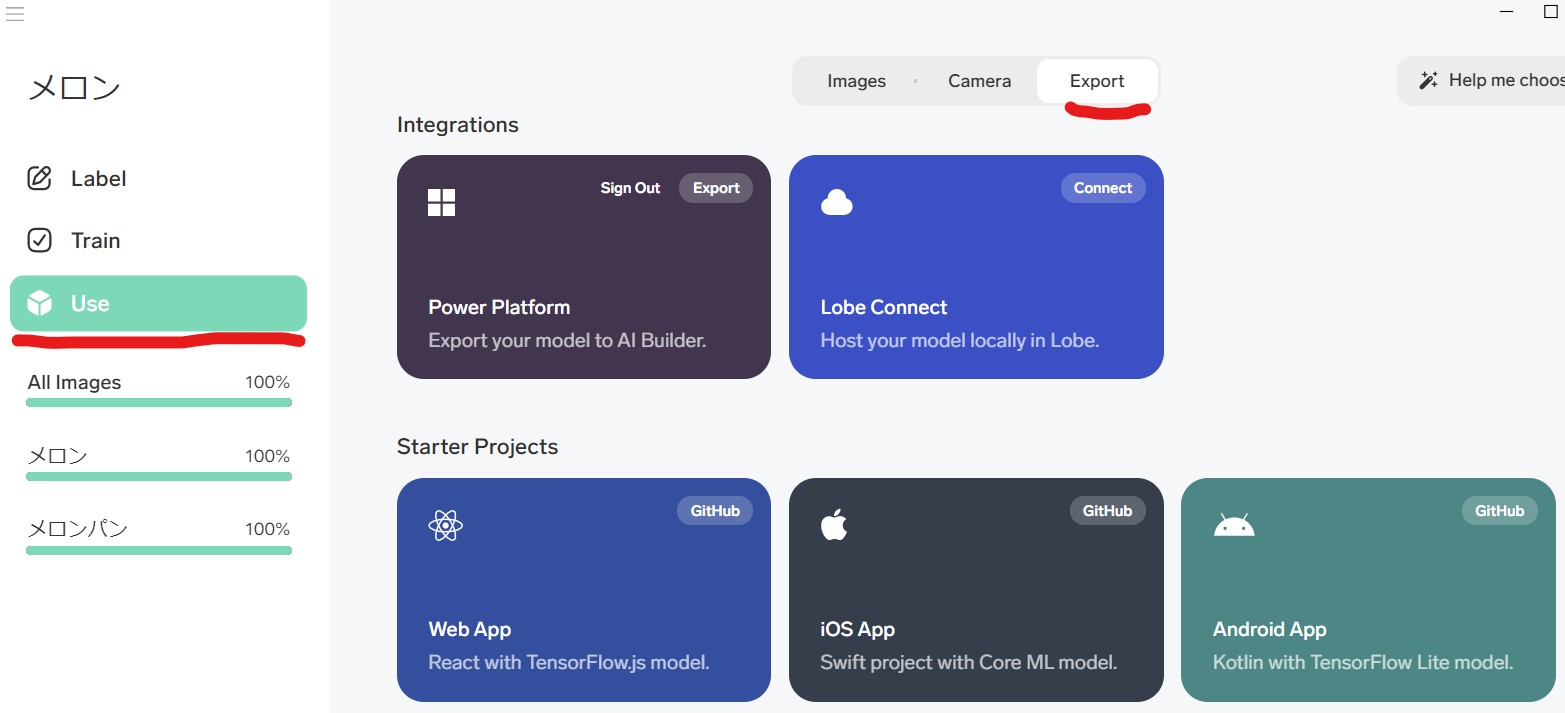

モデルを開いた後Use>Export>IntegrationsにPower Platfolmがあるので進みます。

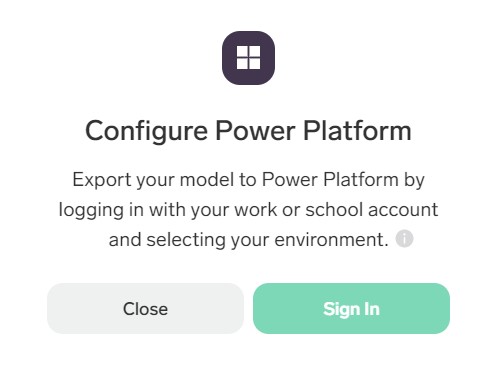

Power Platfolmにサインインします。

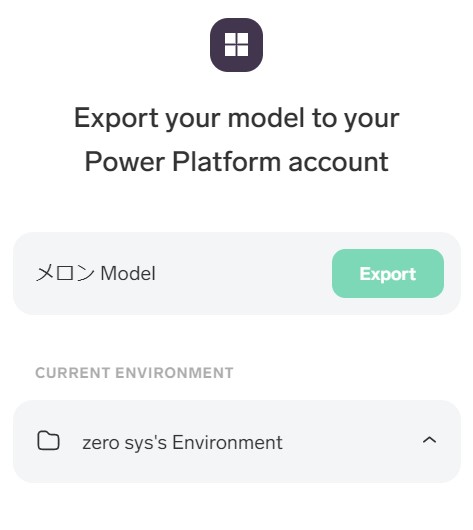

環境を選択しExportします。

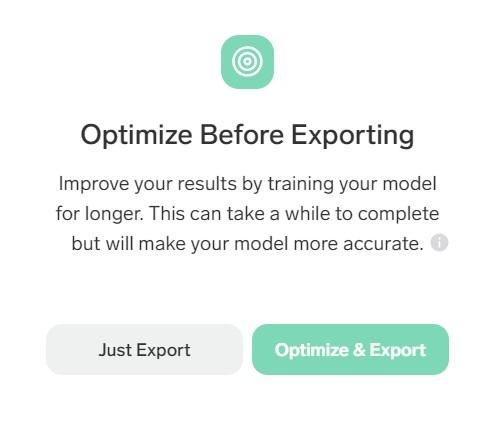

ここでは最適化してExportしました。

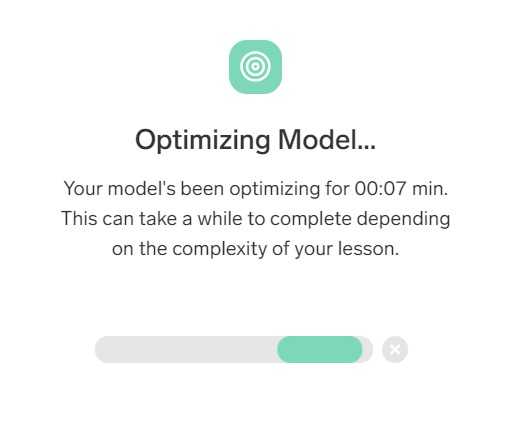

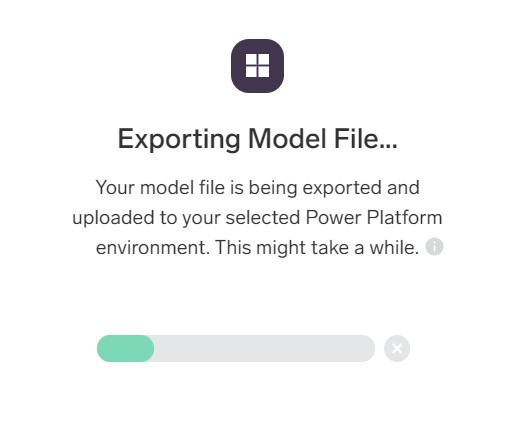

最適化され。

Exportされます。

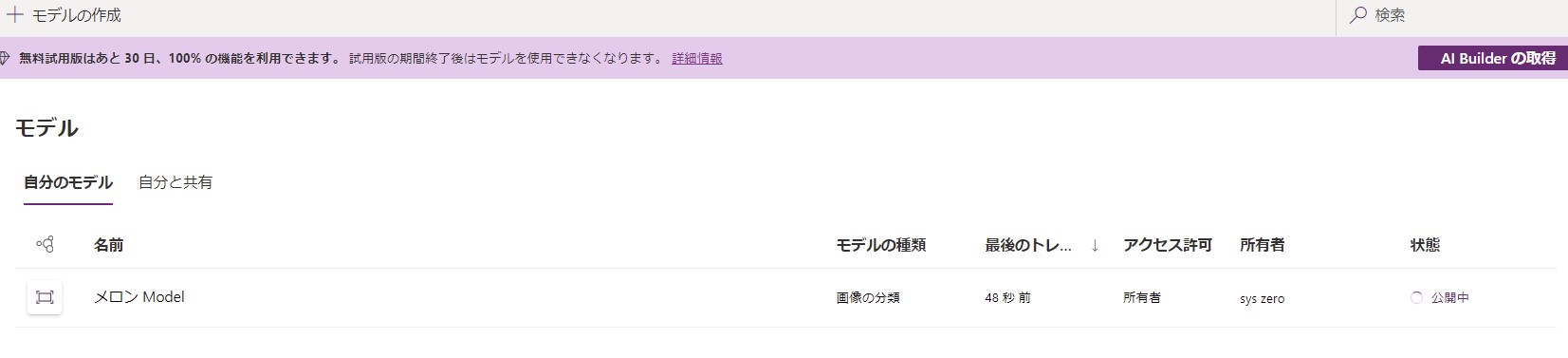

完了したらView Modelで環境に公開されたモデルを確認します。

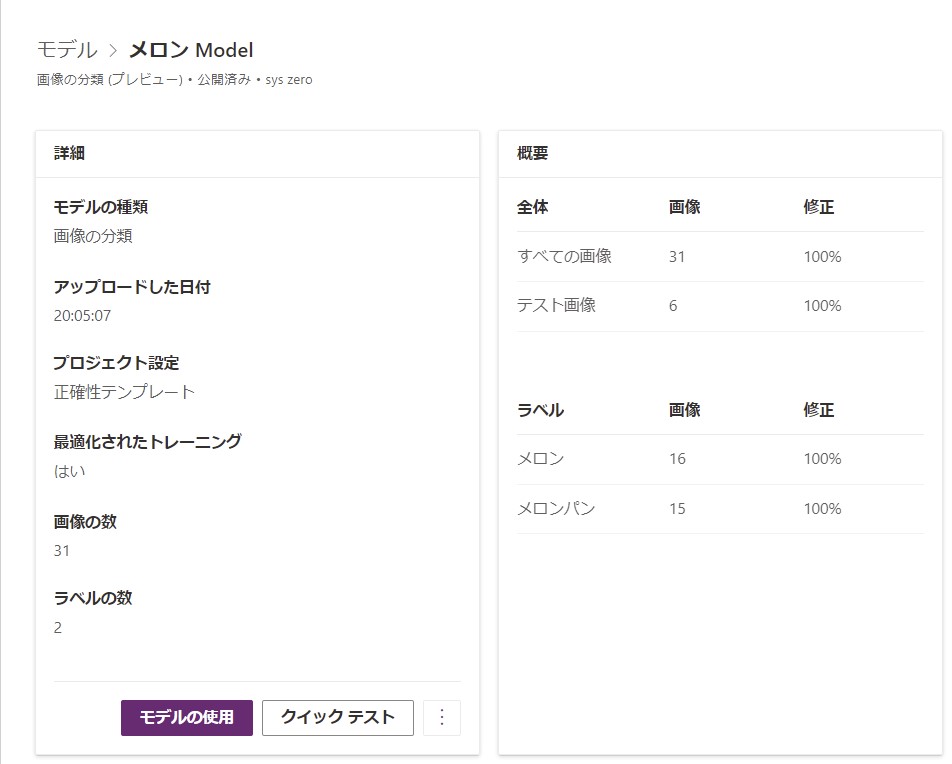

公開されたモデルの詳細を確認します。

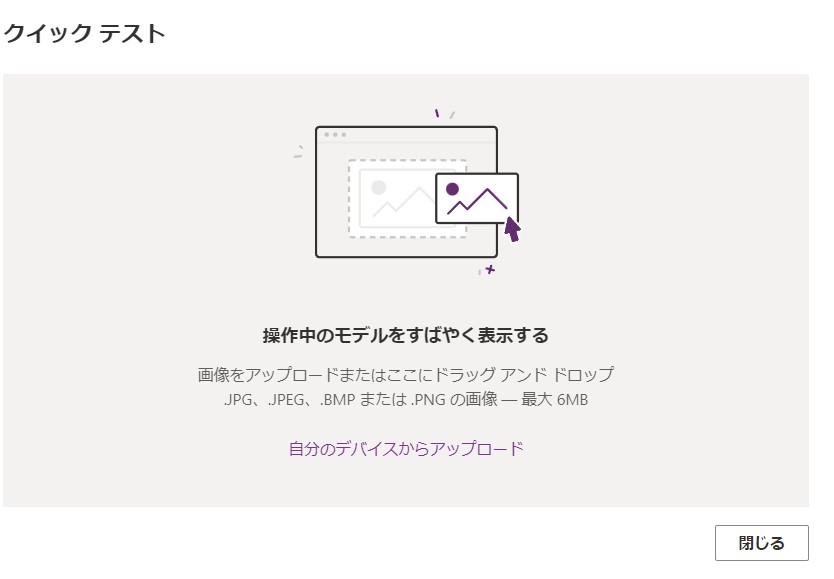

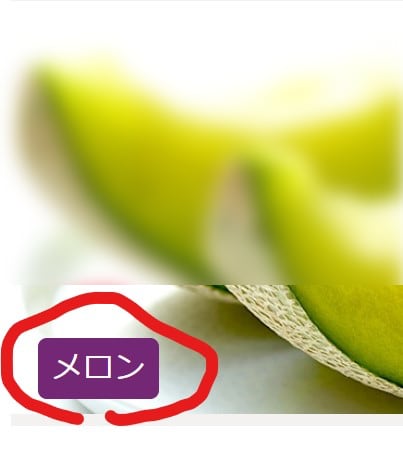

クイックテストで動作確認してみます。

動作確認できたので次にPower AutomateとPower Appsから試します。

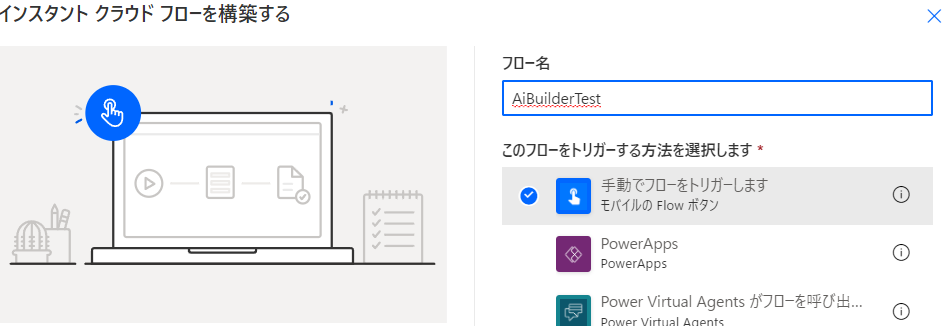

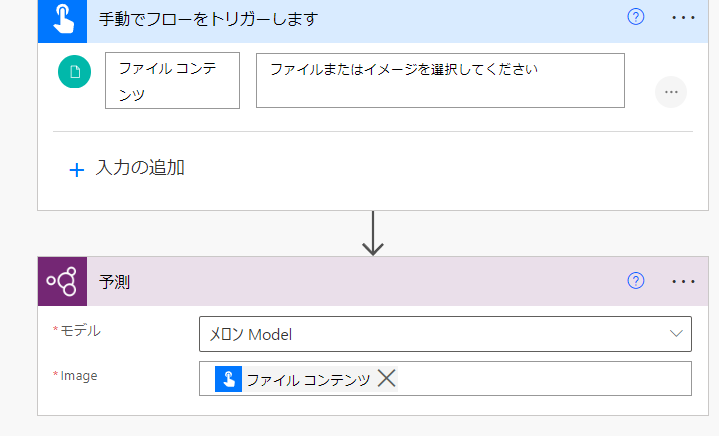

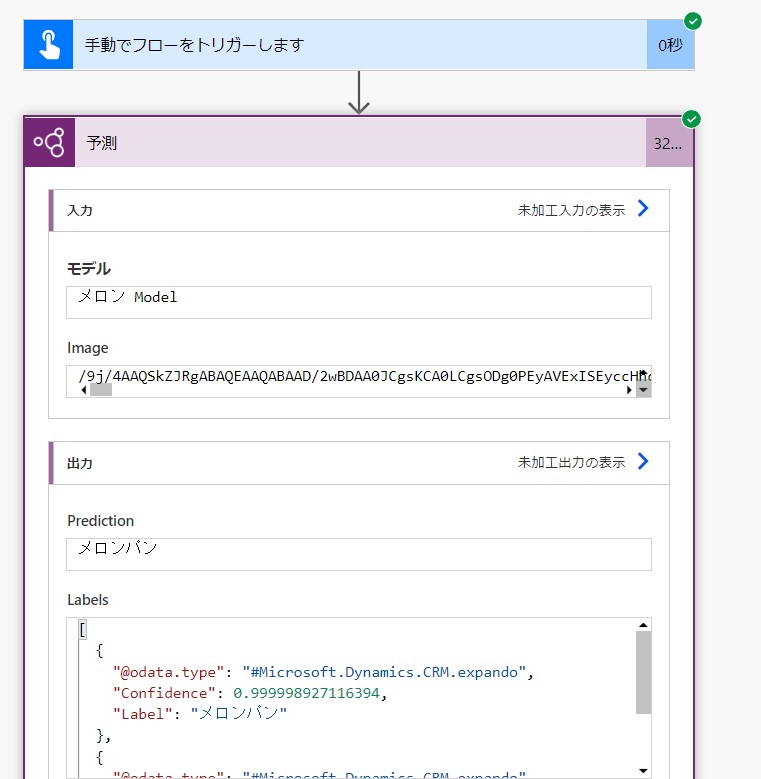

Power AutomateからAI Builderのカスタムモデルを使用

手動でフローをトリガーします。

ファイルコンテンツを入力に追加し 予測のモデルに公開したカスタムモデルを指定します。

このような形で結果が返ってきます。

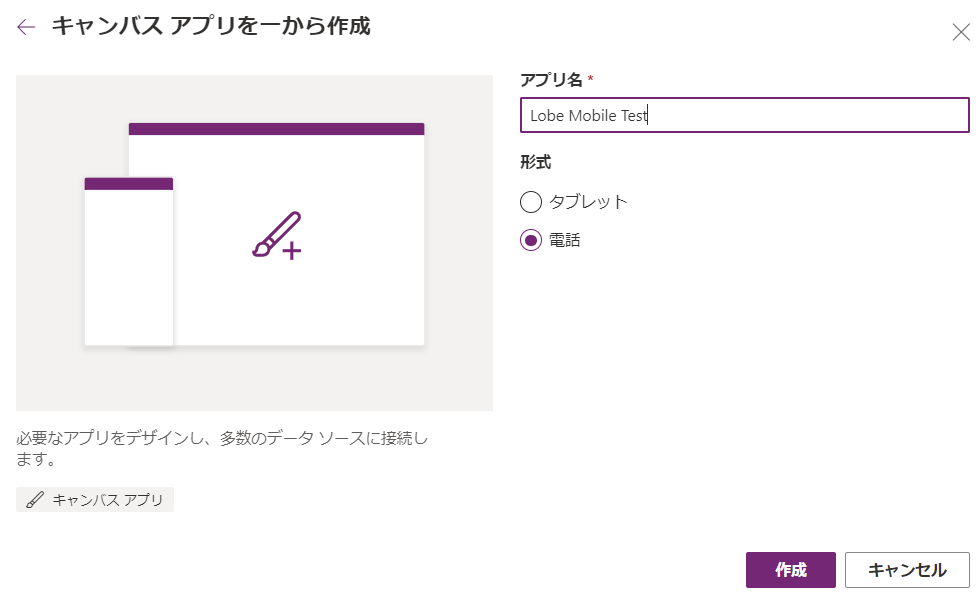

Power AppsからAI Builderのカスタムモデルを使用

キャンバスアプリを作成します。今回は携帯電話(iphone)で試しました。

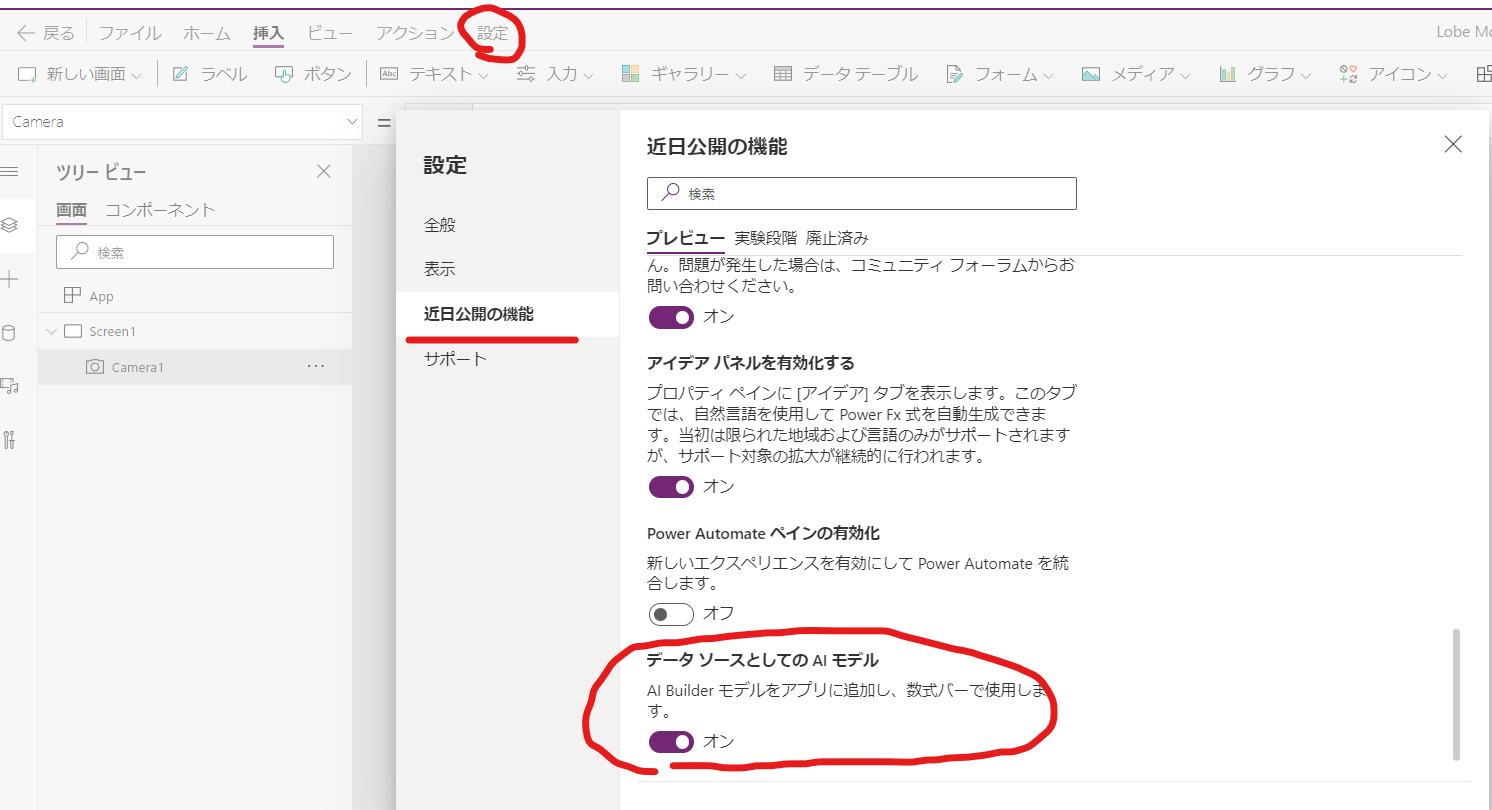

設定からデータソースとしてのAIモデルがオンになっていることを確認します。

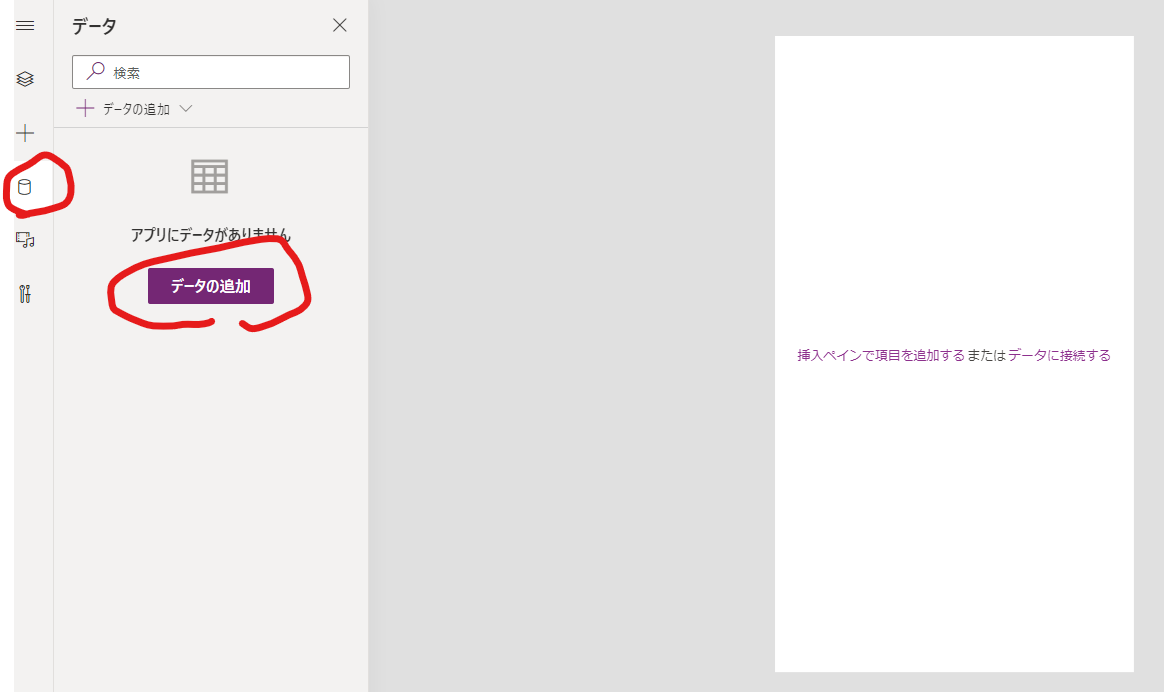

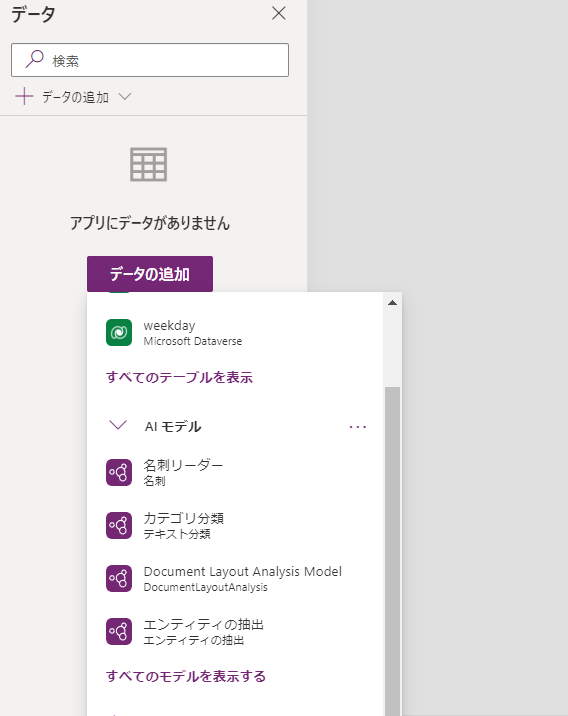

データを追加します。

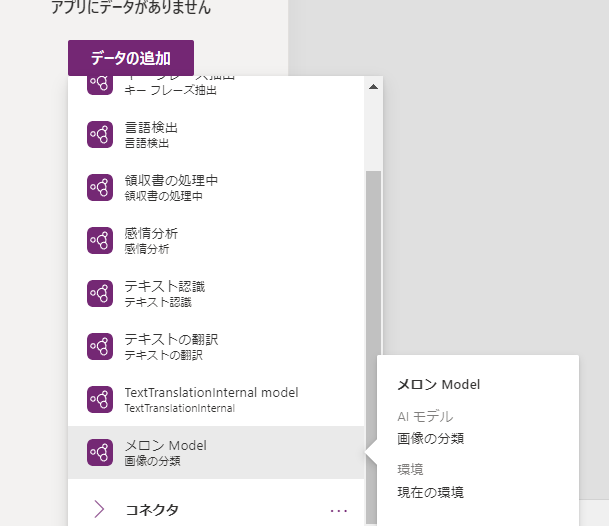

AIモデル>すべてのモデルを表示するから公開したカスタムモデルを指定します。

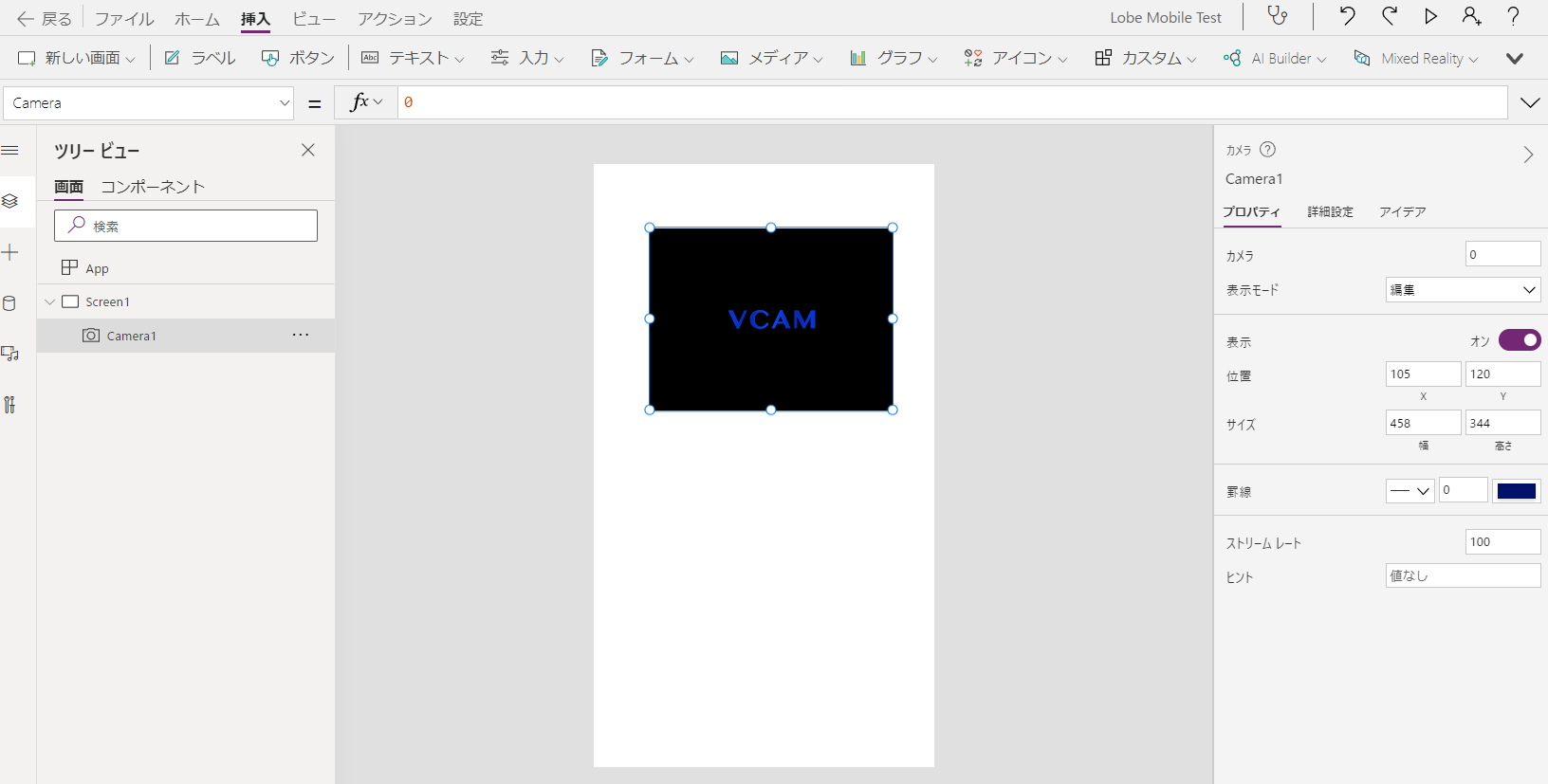

カメラコントロールを追加します。ストリームレートを100にします。PCに接続したWebカメラからテストする場合は適宜カメラの番号を変更します。私の環境ではWebカメラを使用するときは1です。iphoneのときは0にしました。

ボタンコントロールを追加します。

OnSelectプロパティにSet(Pict,Camera1.Stream)としボタンを押したとき画像を読み込みます。

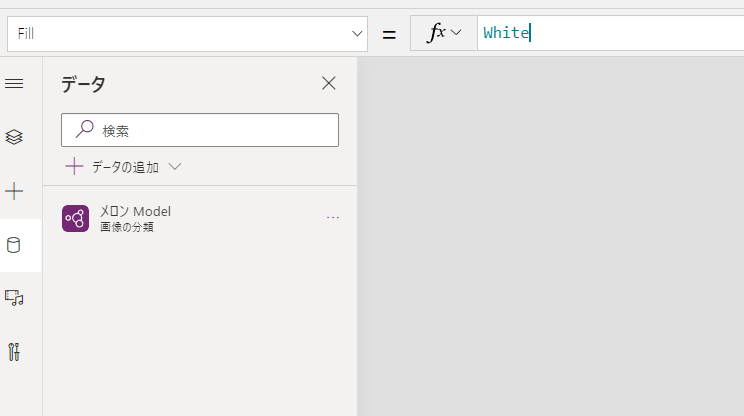

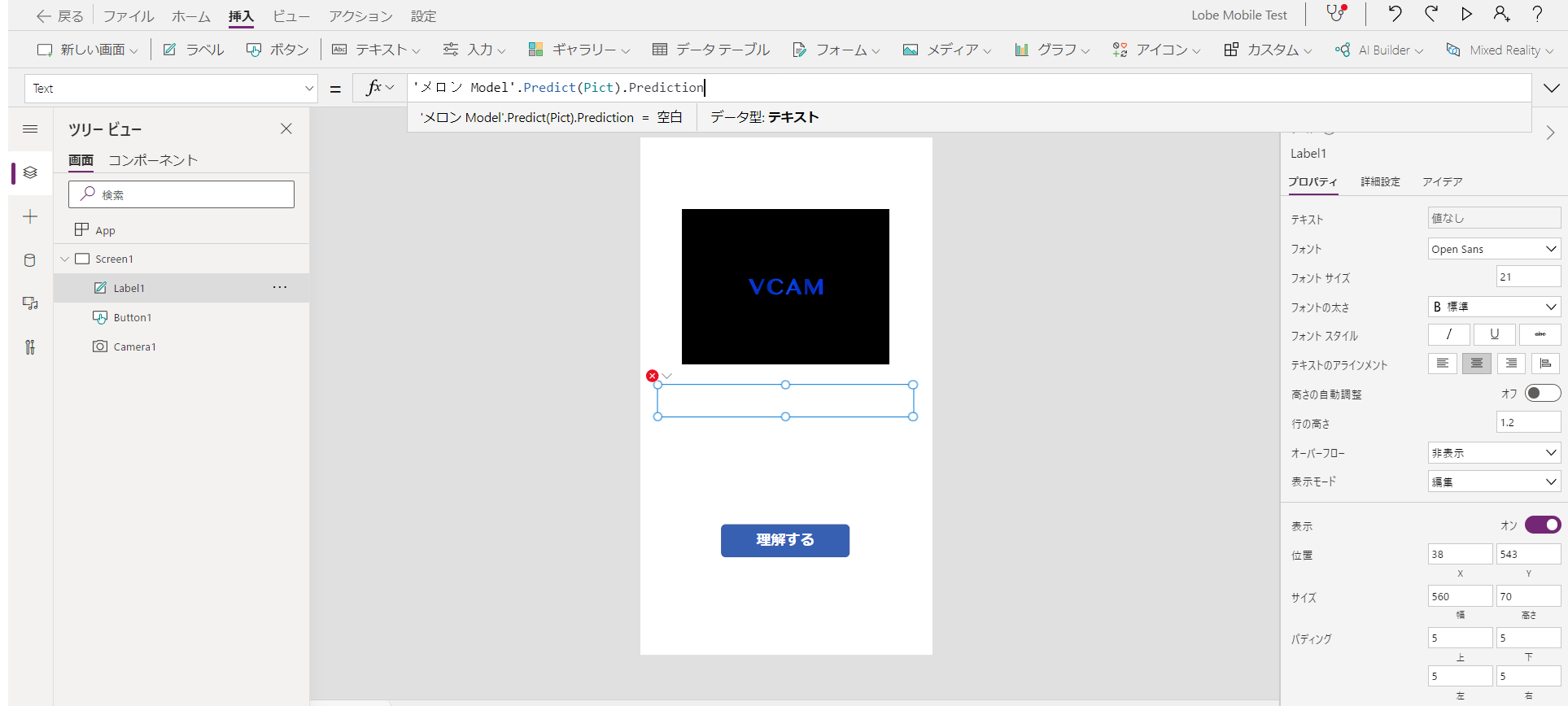

判定を表示するラベルコントロールを追加します。Textプロパティに次のように関数を設定します。

'メロン Model'.Predict(Pict).Prediction

Power Fxによりこれだけの関数でモデルを呼び出して使用できます。

保存して携帯から試してみます。アプリが見えるようになるまで少し時間がかかるかもしれません。起動するとカメラへのアクセス許可がでるので付与します。

なお画像を読み込むまで(ボタンを押すまで)エラーメッセージが出ています。

ボタンを押し、分類できれば成功です。

まとめ

Lobeを使用し学習したカスタムモデルをノーコードでアプリに組み込んで公開できることがわかりました。正直とても簡単で驚きました。試用期間中に他の機能もレポートできればと思います。仕事でもAI Builderも有効活用したいなぁ。